Seed-Thinking-v1.5

https://github.com/ByteDance-Seed/Seed-Thinking-v1.5

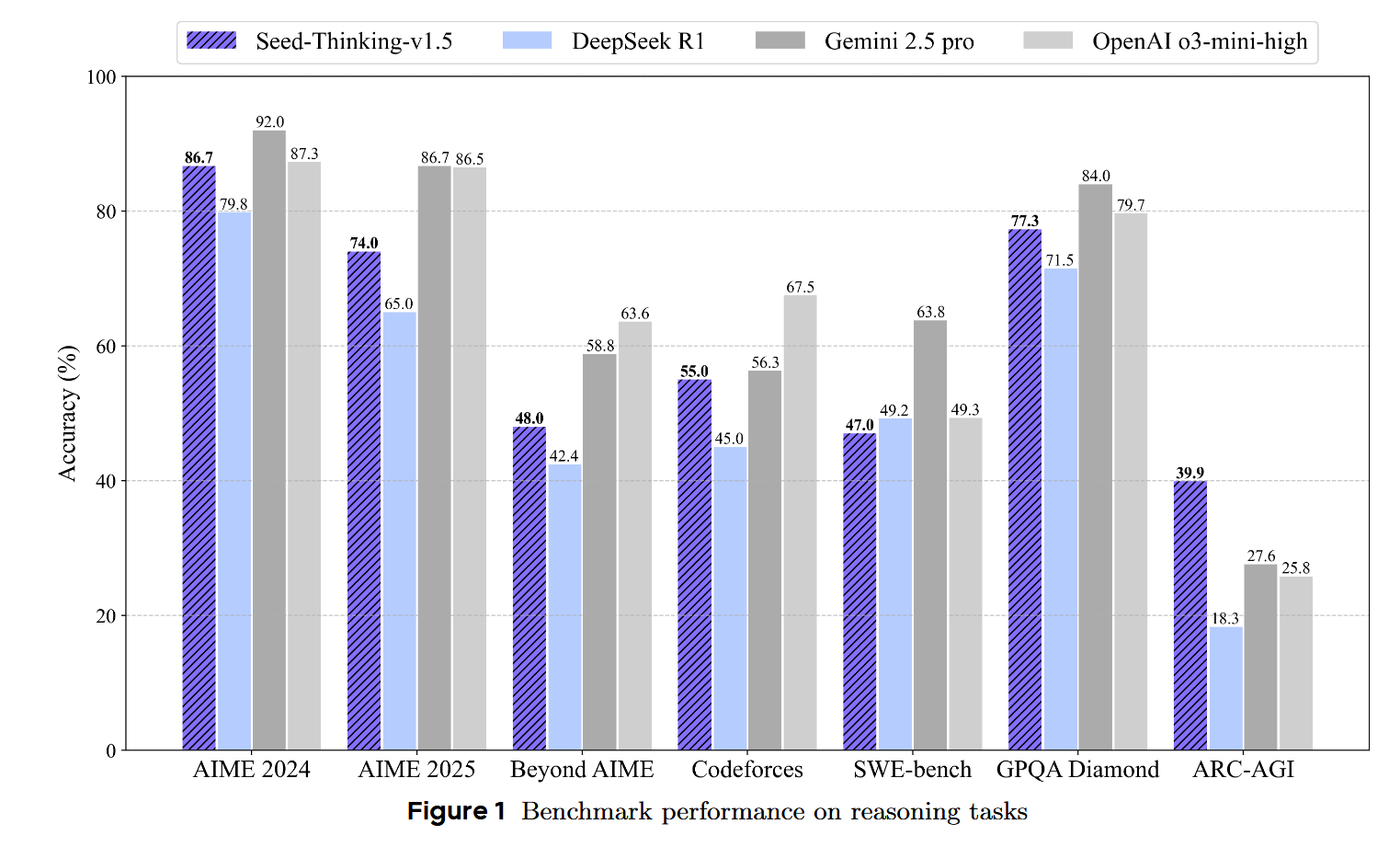

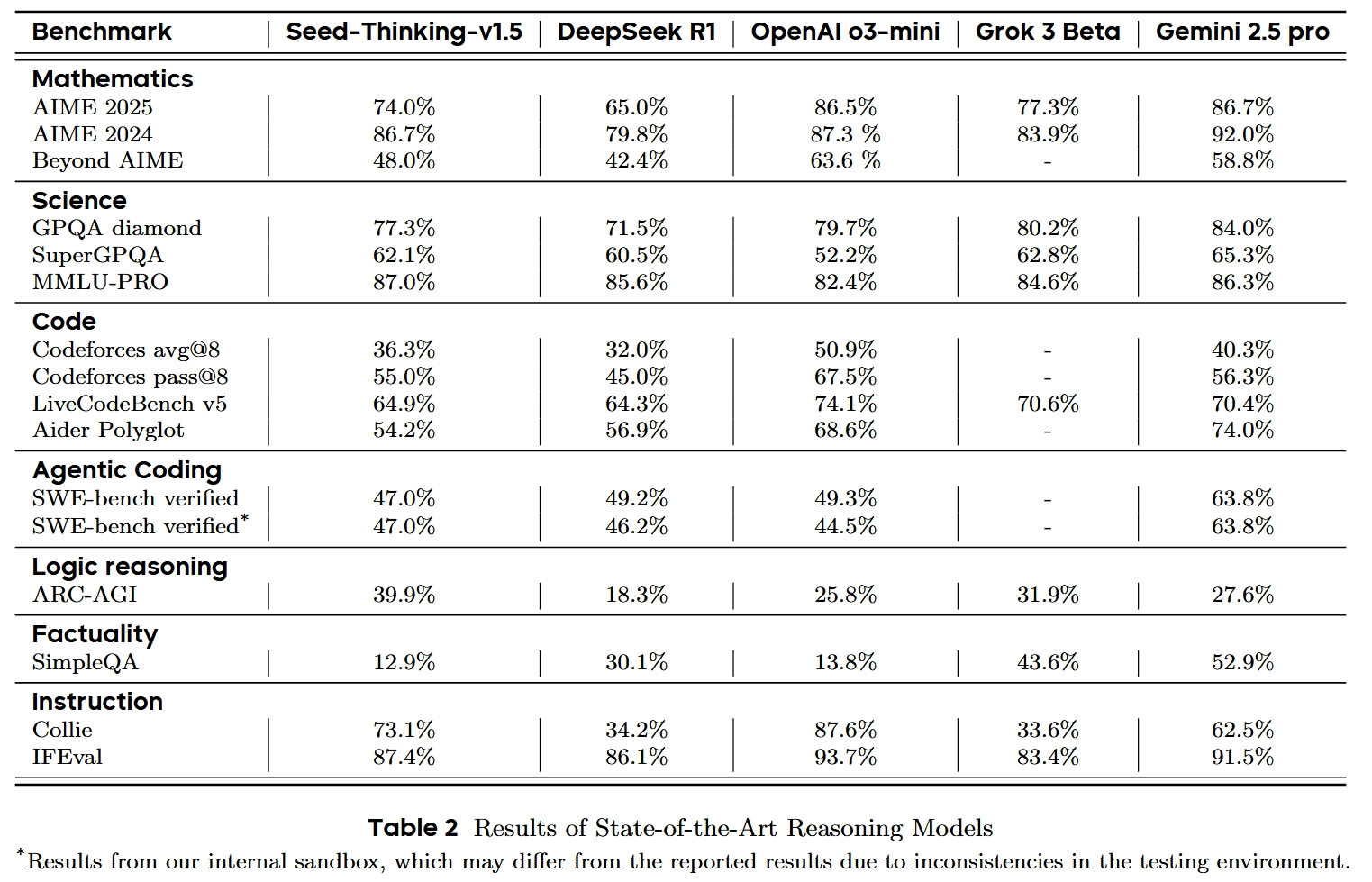

Seed-Thinking-v1.5 是 ByteDance Seed 团队开发的一个先进推理模型,采用 Mixture-of-Experts (MoE) 架构,具有 200B 总参数和 20B 激活参数。该模型的核心创新在于其"思考后回答"的机制,在数学、编程、科学推理等任务上取得了卓越的性能。相比DeepSeek R1 ,在很多数据指标上都取得了一定程度的进步。

数据

训练数据分为两大类:可验证问题(有明确答案)和不可验证问题(无明确答案)。模型的推理能力主要来自第一部分,并能泛化到第二部分。

可验证问题数据

可验证数据主要包含 STEM数据, 编程数据,以及逻辑推理数据

- STEM 数据

- 数据组成:包含数十万道高质量竞赛级别问题, 涵盖数学、物理、化学,其中数学占比超过 80%;

- 数据清洗:初步删除问题陈述不完整、符号不一致或要求不明确的问题; 进一步过滤过于简单的数据以及有可能答案是错误的数据

- 数据增强:将选择题转换为填空题或简答题格式,消除猜测可能性

- 数据规模:最终获得 100K STEM 训练问题,训练时使用基于模型的 Seed-Verifier (后面会提到) 评估响应正确性。

- 编程数据

- 数据来源与筛选:主要来自高质量的竞争性编程竞赛, 每个问题必须包含:清晰的问题描述, 一组单元测试以及检查器脚本(验证功能正确性并强制执行额外约束)

- 评估方法:最准确的评估形式是向官方平台提交生成的代码, 但强化学习期间无法实时提交,因此开发了离线评估集, 所有训练和评估问题都集成到内部代码沙箱环境中

- 逻辑推理数据

- 数据构建:收集 22 个常见任务:24点、迷宫、数独等;并为每个任务构建:数据生成器和答案验证器

- 数据验证:可配置生成问题的难度, 根据模型在特定任务上的表现逐步调整训练数据难度

- 数据规模:生成约 100K 逻辑推理问题用于 RL 训练

不可验证问题数据

这其中的数据主要包含需要基于人类偏好评估质量的非推理任务,涵盖 创意写作、翻译、知识问答、角色扮演等, Prompts来源于 Doubao-1.5 Pro 的 RL 训练数据

数据筛选策略:

- 去除低方差样本:使用 SFT 模型为每个提示生成多个候选, 使用奖励模型评分, 删除得分方差低的提示

为什么要删除低方差样本?

低方差意味着:模型对这个提示生成的多个回答质量都很相似, 分数都集中在一个很小的范围内,例如:5个回答的分数可能是 [7.1, 7.2, 7.0, 7.1, 7.2]

这种情况表明:

1. 采样多样性有限:模型无论怎么生成,产出的内容都差不多

2. 改进潜力极小:即使通过 RL 训练,也很难让模型在这个提示上产生更好的回答

实际例子,假设有两个提示:

提示 A:"今天天气怎么样?"

- 模型回答的分数:[6.0, 6.1, 5.9, 6.0, 6.1]

- 方差很小,因为这是个简单问题,回答空间有限

提示 B:"写一个关于时间旅行的科幻故事"

- 模型回答的分数:[4.5, 7.8, 6.2, 8.1, 5.0]

- 方差很大,因为创意写作有很大的发挥空间

为什么这对 RL 训练很重要?

在强化学习中:

- 需要探索空间:模型需要能够生成质量差异较大的回答,才能学习什么是好的、什么是不好的

- 需要改进潜力:如果所有回答都差不多,RL 很难找到优化方向

- 避免资源浪费:在没有改进空间的样本上训练是低效的

- 去除过于简单的数据:

- 删除在 Doubao 1.5 Pro RL 训练中奖励分数提升超过特定阈值的提示

- 这些数据可能过于简单或在数据集中已经大量存在

- 离线实验表明,过度优化此类样本会导致模型探索空间过早崩溃

评分方法:采用成对奖励方法进行评分和 RL 训练,通过比较两个样本的相对质量帮助模型更好地理解用户偏好。

BeyondAIME 高级数学基准

作者也根据实际的需要,拓展了以下评测集(AIME):

- AIME 每年仅发布 30 道题目,样本量有限导致评估结果方差大

- 难以有效区分最先进的推理模型

构建过程:

- 与数学专家合作开发原创问题

- 系统性地改编现有竞赛问题,通过结构修改和场景重新配置

- 确保答案永远不是琐碎值(如问题陈述中明确提到的数字)

- 最终编制 100 道问题,难度等于或大于 AIME 最难问题

- 所有答案保证为整数(不限于特定数值范围)

奖励建模

奖励建模是 RL 的关键组件,定义了策略试图实现的目标。设计良好的奖励机制对于在训练阶段为模型响应提供精确可靠的奖励信号至关重要。

作者针对上面可验证性和不可验证性的数据划分分别设计了不同的奖励方式

可验证问题的奖励建模

这里作者也用了两种模型来进行reward model的建模

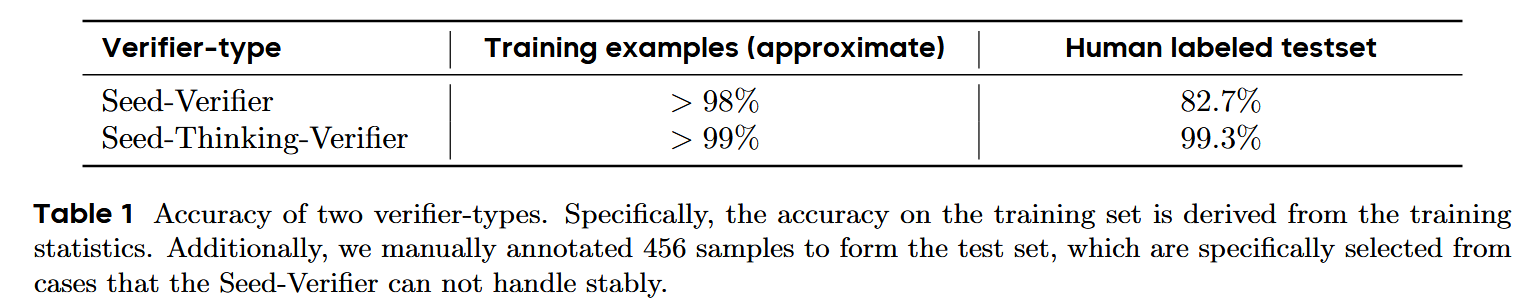

- Seed-Verifier:

- 验证逻辑:基于人类精心设计的一套原则,利用 LLM 评估三元组:(问题、参考答案、模型生成答案),如果参考答案和模型生成答案本质上等价,返回"YES";否则返回"NO"

- 等价性判断:不是字面上的精确匹配, 而是基于计算规则和数学原理的深度评估证明两个答案传达相同的数学含义,来确保奖励信号准确反映模型响应的本质正确性

- Seed-Thinking-Verifier:

- 验证逻辑:受人类判断过程启发,通过细致思考和深入分析生成结论性判断,训练了一个verifier model,该模型为其评估提供了详细的推理路径,

- 等价性判断:将验证视为可验证任务,与其他数学推理任务一起优化,模型可以剖析参考答案和模型生成的答案之间的相似性和差异,从而提供精确和细微的判断结果。

- 核心优势

- 解决奖励黑客问题:非思考模型可能利用漏洞获得奖励而不真正理解问题,详细的推理过程使这种黑客行为更加困难

- 消除预测不确定性:对于本质等价但格式不同的答案(如 \(2^{19}\) vs 524288)Seed-Verifier 可能返回不一致的结果;Seed-Thinking-Verifier 通过彻底分析答案背后的推理提供一致结果

- 处理边缘案例:Seed-Verifier 难以有效处理某些边缘案例; 而 Seed-Thinking-Verifier 通过提供详细推理更好地处理复杂场景

二者的性能指标对比如下表所示:

结果表明,Seed-Thinking 在某些特定情况下,处理起来比较困难和挣扎,而 Seed-Thinking-Verifier 表现出了出色的判断能力。尽管后者的思维过程确实消耗了大量的GPU资源,但作者认为,它产生的确切和强大的奖励结果对于赋予该政策具有强大的推理能力至关重要。

不可验证问题的奖励建模

对于不可验证的问题数据,作者采用了成对生成奖励模型(pairwise generative reward model)来评估两个响应的优劣,使用"YES"或"NO"的概率作为最终奖励分数。

训练数据与 Doubao 1.5 Pro 使用的人类偏好数据一致,主要包括创意写作和摘要等类别。

Pair-wise Reward Model

这里的奖励模型来源于文章 《A Unified Pairwise Framework for RLHF: Bridging Generative Reward Modeling and Policy Optimization》

目标和设计:评估两个响应( \(y\) 和 \( y^* \))联合,简化任务为相对的判断。

利用预训练的语言模型将比较构建成自然语言理解问题,如提示:“给定问题 \(q\) 和规则 \(R\),响应 \( y^* \) 是否优于 \(y\)?回答Yes/No。[MASK]”。其中, [MASK] 是在训练期间用“Yes”或“No”取代的地方。

这样做的优势在于

- 模型能够在评分时直接比较响应之间的相对差异,避免过度关注无关细节

- 奖励模型继承了Pretrain模型的上下文理解能力和语义生成能力,并加入了判别能力。

训练:

- 使用词汇表上的softmax交叉熵损失进行训练。对于比较实例 \(\{(y_i, y_i^*)\}\):

- 通过以下方法解决位置偏差:

- 数据增强:生成成对样本,其中 \(y\) 在 \(y^{*}\) 之前和之后的样本都包含在同一个批次中。

- 引入均方误差(MSE)约束:

- 平衡这些损失的总训练目标: 其中 \(\zeta\) 平衡了权重,通常较小以保持一些位置差异信息。

训练方法

监督微调(SFT)

训练数据总计包含 400K个训练实例, 其中,300K个可验证问题(从 RL 训练集随机采样);100K个不可验证问题(来自 Doubao-Pro 1.5 的 SFT 数据)

CoT响应生成流程:

- 冷启动阶段:

- 人类专家应用提示工程技术或者与内部模型进行交互对话,产生具有各种推理模式的响应

- 迭代改进:

- 积累数十个高质量冷启动样本后,训练具有长 CoT 的推理模型

- 使用 Seed-Verifier 对推理模型执行拒绝采样

- 该工作流程主要应用于数学数据,但能很好地泛化到其他领域

强化学习

作者开发了一个统一的增强学习框架,该框架无缝地融合了来自广泛领域的数据。其中包含三种数据类别:

- 可验证数据:从验证器获得反馈

- 通用数据:由奖励模型评分

- 混合数据:结合验证器和奖励模型的分数

在长CoT RLHF的背景下,遇到了一些挑战,例如价值模型偏见和奖励信号的稀疏性。而为了解决这些问题,作者利用了先前工作的关键技术,

这里的工作主要是以下三篇:

- Vapo: Efficient and reliable reinforcement learning for advanced reasoning tasks

- Dapo: An open-source llm reinforcement learning system at scale

- What’s behind ppo’s collapse in long-cot? value optimization holds the secret.

这里只简单介绍一下这些关键技术:

- 价值预训练(Value-Pretraining):

- 从固定策略(如 \(\pi_{sft}\))采样响应,并使用蒙特卡罗回报更新价值模型,确保初始化的价值模型与策略 \(\pi_{sft}\) 完全对齐,这对于保持模型的 CoT 模式至关重要

- 解耦 GAE(Decoupled-GAE):

- 使用不同的 GAE 参数:\(\lambda_{value} = 1.0\), \(\lambda_{policy} = 0.95\), 允许价值模型以无偏方式更新, 该策略可以独立平衡自身的偏差和方差

- 长度自适应 GAE(Length-adaptive GAE):

- 设置 \(\lambda_{policy} = 1 - \frac{1}{\alpha l}\), 其中 \(\alpha\) 是超参数,\(l\) 是响应长度,确保时间差分(TD)误差在短序列和长序列之间更均匀分布

- Clip-Higher:在 PPO 算法中,解耦上下裁剪边界:

通过增加 \(\epsilon_{high}\) 的值,为低概率 token 的增加创造更多空间,鼓励模型探索更广泛的可能响应。

- Token 级损失:

- 在所有 token 上定义策略损失,而不是整个响应, 解决 token 级别对最终损失贡献的不平衡问题

- 正例语言模型损失(Positive Example LM Loss):

- 提高 RL 训练过程中正例的利用效率:

其中 \(\mu\) 是系数,\(L_{NLL}\) 是负对数似然损失。

- 在线数据分布适应:

- 将强化学习期间的静态提示分布转换为自适应分布, 更好地满足训练期间模型的需求, 最小化数据干扰的负面影响, 确保跨不同能力更平衡

Infrastructures

框架架构

核心设计:

- 使用 HybridFlow 编程抽象构建

- 在 Ray 集群上运行

- 数据加载器和 RL 算法在单进程 Ray Actor(单控制器)中实现

- 模型训练和响应生成在 Ray Worker Group 中实现

- 通过 SPMD(单程序多数据)在 Worker Group 内运行重型训练/生成工作负载

流式推出系统(SRS)

设计动机:长 CoT 生成中存在严重的掉队现象,不同提示的响应长度差异很大,导致生成期间大量 GPU 空闲时间

所以作者引入了流式推出以解耦模型演化和运行时执行

- 通过参数 \(\alpha\) 动态调整 on/off-policy 样本比率:

- 完成率 \(\alpha \in [0, 1]\):使用最新模型版本生成的 on-policy 样本比例

- 剩余部分 \((1-\alpha)\) 分配给来自版本化模型快照的 off-policy 推出

技术特点:

- 动态精度调度:通过带误差补偿范围缩放的训练后量化部署 FP8 策略网络

- 三层并行架构:

- TP(张量并行)用于逐层计算

- EP(专家并行)具有动态专家分配

- SP(序列并行)用于上下文分块

- 内核自动调优器:基于实时负载监控动态选择最优 CUDA 内核配置

训练系统优化

并行机制:

- 组合 TP/EP/CP 与完全分片数据并行(FSDP)

- 对注意力层应用 TP/CP

- 对 MoE 层应用 EP

关键优化:

- 序列长度平衡:使用 KARP 算法重新排列小批次内的输入序列

- 内存优化:采用逐层重计算、激活卸载和优化器卸载

- 自动并行:AutoTuner 建模内存使用并估计各种配置的性能

- 检查点:使用 ByteCheckpoint 支持从不同分布式配置恢复

实验结果与发现

总结

Seed-Thinking-v1.5 通过创新的数据策略、奖励建模方法和强化学习技术,在保持相对较小模型规模的同时实现了卓越的推理能力。关键成功因素包括:

- 高质量的数据管理:严格的数据清洗、增强和难度控制

- 先进的奖励建模:Seed-Thinking-Verifier 提供了准确可靠的评估

- 稳定的 RL 训练:通过 VAPO 和 DAPO 框架解决了长期存在的不稳定性问题

- 高效的基础设施:SRS 和混合引擎架构显著提高了训练效率

未来的研究方向包括探索更高效的 RL 配方、在思考模式下处理更具挑战性的任务,以及开发与验证器准确度相当的通用奖励建模方法。