Deep Learning

2026-02-27

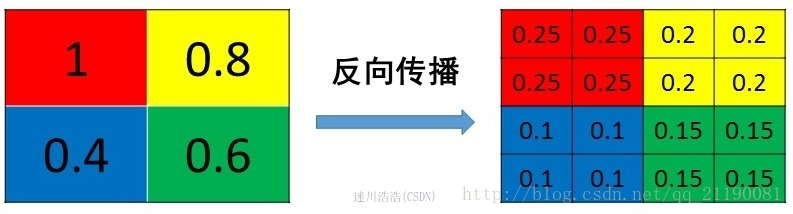

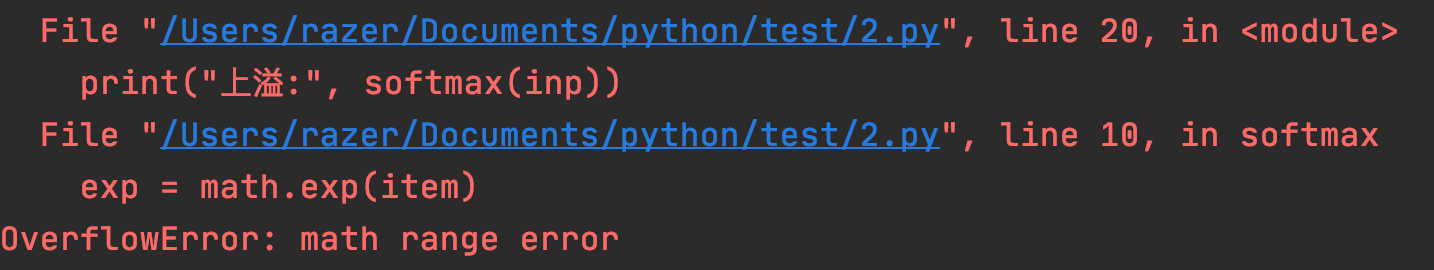

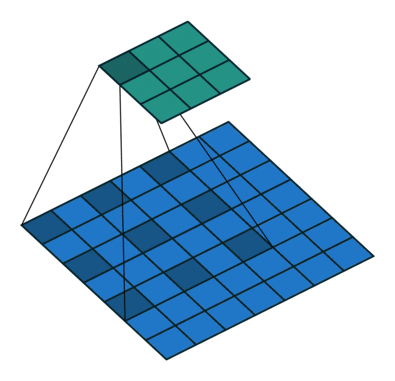

池化: 池化函数使用某一位置的相邻输出的总体统计特征来代替网络在该位置的输出。本质是 降采样,可以大幅减少网络的参数量 。 常用的池化有:均值池化(mean pooling)、最大池化(max pooling)。 pooling操作没有参数量!!! 下面来说说这两种池化的区别与作用: 均值池化 主要用来 抑制邻域值之间差别过大,造成的方差过大 。 如,输入(2,10),通过均值池化后是(6), 对于输入的整体信息保存的很好,在计算机视觉中:因为一般前景的值大于背景,并且背景较多,所以 对背景的保留效果好 反传 mean pooling的前向传播就是把一个patch中的值求取平均来做pooling,那么反向传播的过程也就是把某个元素的梯度等分为n份分配给前一层,这样就保证池化前后的梯度(残差)之和保持不变,还是比较理解的,图示如下 mean pooling比较容易让人理解错的地方就是会简单的认为直接把梯度复制N遍之后直接反向传播回去,但是这样会造成loss之和变为原来的N倍,网络是会产生梯度爆炸的。 最大池化 能够 抑制网络参数误差造成的估计均值偏移的现象 。...