Reinforcement Learning

2026-03-31

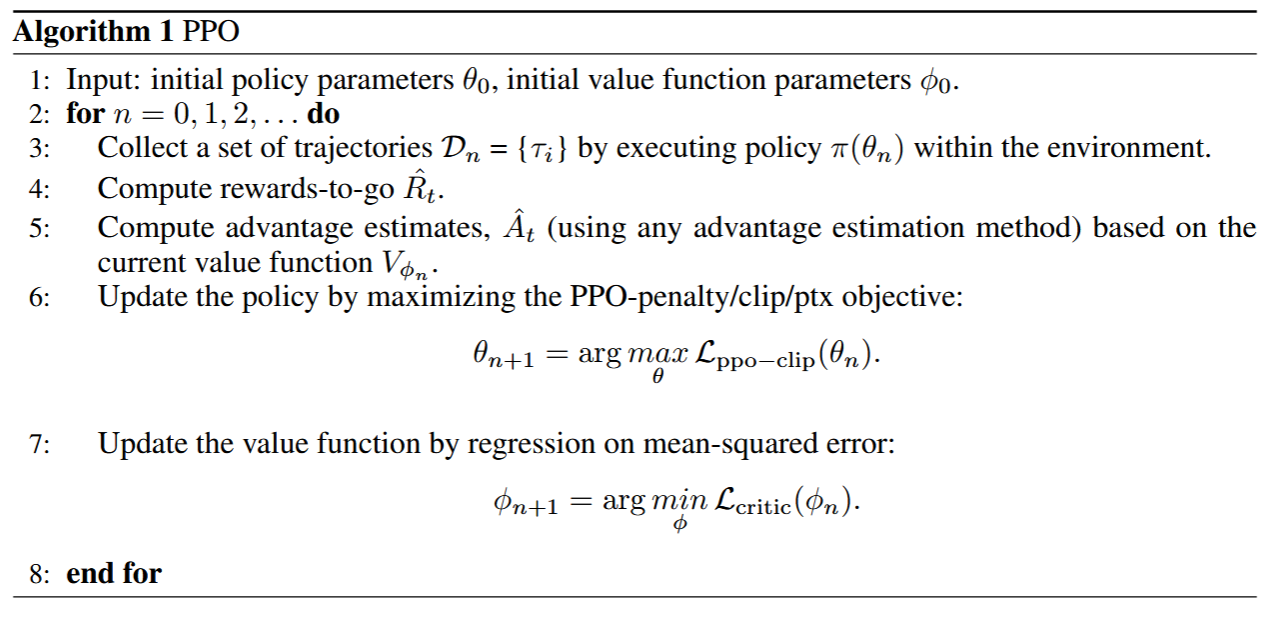

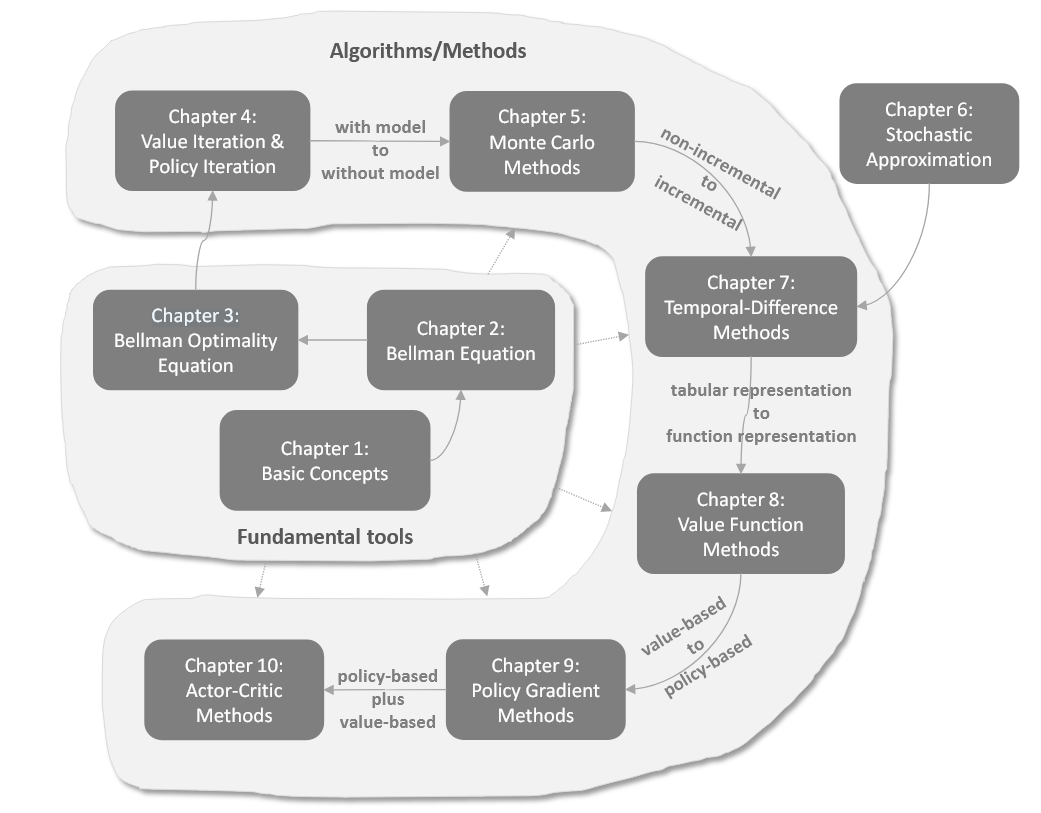

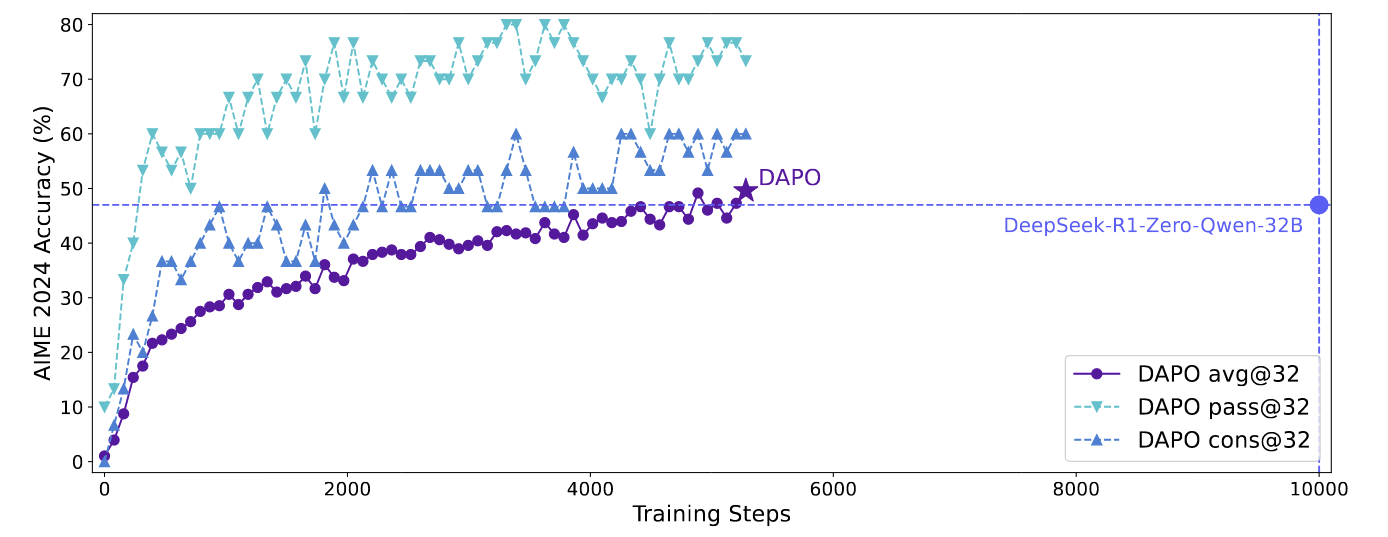

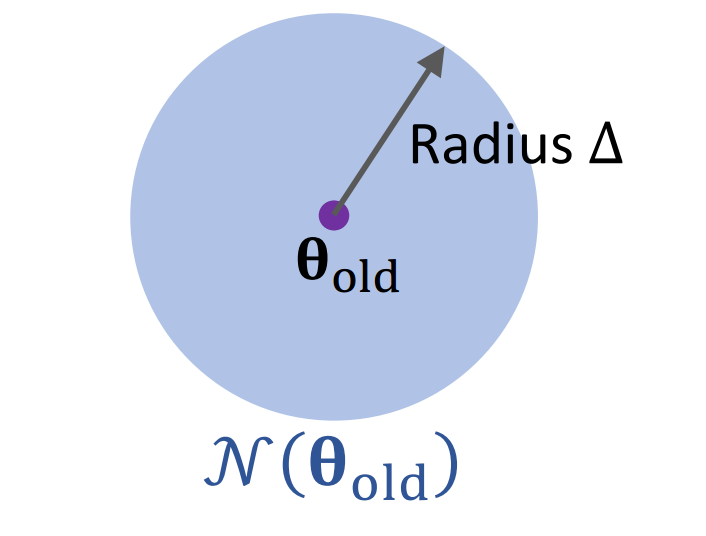

引言 大语言模型(LLMs)在近年来取得了显著进展,展现出上下文学习、指令跟随和逐步推理等突出特性。然而,由于这些模型是在包含高质量和低质量数据的预训练语料库上训练的,它们可能会表现出编造事实、生成有偏见或有毒文本等意外行为。因此,将LLMs与人类价值观对齐变得至关重要,特别是在帮助性、诚实性和无害性(3H)方面。 基于人类反馈的强化学习(RLHF)已被验证为有效的对齐方法,但训练过程复杂且不稳定。本文深入分析了RLHF框架,特别是PPO算法的内部工作原理,并提出了PPO-max算法,以提高策略模型训练的稳定性和效果。 RLHF的基本框架 RLHF训练过程包括三个主要阶段: 监督微调(SFT) :模型通过模仿人类标注的对话示例来学习一般的人类对话方式, 优化模型的指令跟随能力 奖励模型(RM)训练 :模型学习基于人类反馈比较不同回复的偏好 近端策略优化(PPO) :模型基于奖励模型的反馈进行更新,通过探索和利用来发现优化的策略 奖励建模(Reward Model) 奖励模型使用预训练的基于Transformer的语言模型,...